L’annunciata partecipazione del Papa al prossimo G7 del 13-15 giugno non deve stupire visto che l’incontro si tiene in Italia, potrebbe destare più sorpresa il fatto che avverrà nella sessione dedicata alla cosiddetta “Intelligenza Artificiale” (IA). Ma anche questa non è una novità assoluta.

Il primo passo importante che mostra un interesse esplicito del Vaticano nel campo dell’IA è stato mosso in un momento difficile, in concomitanza con il confinamento pandemico del 2020, risale infatti al 28 febbraio di quell’anno la firma del “Rome call for AI ethics”, una sorta di carta di intenti che aveva l’obiettivo di indicare le linee “etiche” lungo le quali si dovrebbero sviluppare le tecnologie collegate all’IA. Il breve documento è stato firmato alla presentazione oltre che dalla “Pontificia Accademia per la Vita”, che l’ha materialmente redatto, dalla Microsoft, dall’IBM, dalla FAO e dal Ministro per l’Innovazione del Governo italiano. A queste si sono aggiunte altre firme, sia di aziende private che di istituzioni pubbliche, oltre che di singole personalità ma si è trattato comunque di un numero decisamente irrilevante di adesioni, almeno tenendo presente il contesto internazionale e l’enorme espansione di quel settore avvenuta nel corso degli anni.

Il documento parte da una elencazione delle aree di maggior impatto dell’IA, sia a livello individuale che ambientale; si tratta di tre ambiti che sono strettamente interconnessi tra loro e quindi la sovrapposizione degli argomenti è inevitabile. Il primo riguarda la dimensione “etica”, rispetto alla quale si mette in guardia sull’uso di una tecnologia che potrebbe portare all’incremento di pregiudizi e stereotipi e quindi di discriminazioni. La seconda è quella “educativa” per cui accanto agli aspetti positivi non andrebbero sottovalutati i rischi della creazione di esclusioni sociali di un nuovo tipo, quello provocato direttamente dalla tecnologia. Infine viene affrontata la dimensione dei “diritti” un campo strettamente collegato alle libertà individuali e collettive, che rischiano di essere messe in discussione dall’uso “non etico” delle applicazioni basate sull’IA. Per cercare di mitigare i numerosi problemi che potrebbero presentarsi vengono indicati una serie di “valori guida” che dovrebbero essere alla base e indirizzare la progettazione, lo sviluppo e l’uso della tecnologia in questione. La “trasparenza” che dovrebbe riguardare il funzionamento dei sistemi e la chiarezza sui loro scopi; la “inclusione” al fine di rispettare tutte le persone allo stesso modo; la “responsabilità” morale nelle scelte che dovrebbero guidare i progettisti dei sistemi di IA; la “imparzialità” delle scelte e la “qualità” dal punto di vista tecnico; la “sicurezza” legata al rispetto e alla protezione dei dati personali.

Il documento “Rome call for AI ethics”, che abbiamo brevemente descritto, affronta una serie di problematiche di enorme importanza e non solo per quello che riguarda la cosiddetta IA ma per tutto il settore delle tecnologie informatiche e non solo quelle. I pericoli che vengono indicati e le soluzioni che vengono proposte sono sicuramente reali e, almeno in linea generale, potrebbero essere condivisibili persino da anarchici, da atei e anticlericali.

Ci sono però nel testo alcune macroscopiche carenze che lo rendono in concreto esclusivamente un elenco di buoni propositi.

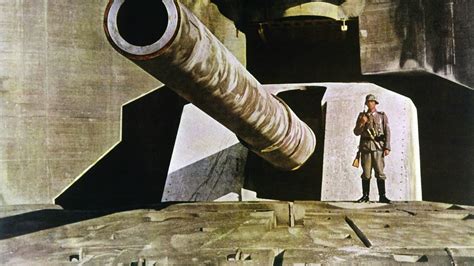

La prima è quella relativa agli utilizzi militari. Nel documento è presente solo un passaggio dove si afferma che è necessario che l’IA sia uno strumento per “costruire e mantenere la pace internazionale”, un invito che sembra ignorare il fatto che l’uso militare di determinate tecnologie è uno dei settori maggiormente in espansione oltre che tra quelli che generano maggiori profitti. Giusto per ricordarlo, un termine come “bombe intelligenti” esiste ben da prima che scoppiasse la moda dell’IA.

Un altro punto debole è che non si prende in considerazione l’aspetto economico connesso, una scelta probabilmente voluta, ma non giustificabile in un testo che pretende di fornire una guida “etica”. Questa mancanza è significativa sia visto che da qualche anno la quantità di denaro coinvolta nel settore specifico è in costante aumento sia se si tiene conto dell’impatto che alcune delle applicazioni già hanno avuto e che avranno nel prossimo futuro sull’organizzazione e sullo sfruttamento del lavoro umano.

Il Papa è tornato sull’argomento recentemente, nel messaggio in occasione della “LVIII Giornata Mondiale delle Comunicazioni Sociali” (24/01/2024), rinnovando l’appello rivolto alla comunità internazionale “a lavorare unita al fine di adottare un trattato internazionale vincolante, che regoli lo sviluppo e l’uso dell’intelligenza artificiale nelle sue molteplici forme”. Cosa che, almeno in parte, è già stata tentata, risale infatti allo scorso mese di marzo l’approvazione da parte del Parlamento dell’Unione Europea di un complesso e criticato “Regolamento” riguardante l’IA, che però non è ancora pienamente in vigore. Persino il Governo italiano già alla fine del 2021 aveva approvato un pretenzioso documento titolato “Programma strategico” (2022-2024) nel settore dell’IA. Nel gennaio di quest’anno l’Esecutivo in carica ha mandato in pensione quel programma (del resto mai attuato) e annunciato, alla fine di aprile, un apposito Decreto Legge del quale però non è ancora disponibile un testo ufficiale ma esclusivamente alcune anticipazioni giornalistiche.

In questo momento ovviamente non conosciamo il contenuto dell’intervento del Pontefice nel contesto del G7, ma siamo pronti a scommettere che sarà destinato a riscuotere un grande successo di critica e di pubblico. Sulla possibilità che le Aziende e i grossi conglomerati finanziari coinvolti nel settore dell’IA decidano di comportarsi in maniera “etica” nutriamo invece la solida certezza che sia un evento impossibile. Ci vorrebbe un miracolo, a crederci.

Pepsy